La compréhension du fonctionnement du cerveau et de l’IA a beaucoup évolué.

Le meilleur modèle que nous ayons actuellement date des années 1970 et est basé sur des réseaux neuronaux. Pour chaque caractéristique, on associe une connaissance ou une émotion. On reconstruit les concepts à chaque fois qu’on en a besoin. Nos mémoires sont reliées les unes aux autres par des caractéristiques communes. Le cerveau réutilise les caractéristiques. Il ne réenregistre pas les éléments en commun. Ce dont on se souvient, c’est une reconstruction. Le cerveau finit par éliminer les concepts qui ne sont pas souvent sollicités. Cela se passe la nuit, c’est le REM (rapid eye movement) car pendant cette phase, les yeux font des mouvements rapides. Par exemple, si on a été mordu par un chien, on oubliera moins et on associera plus des caractéristiques dangereuses au chien.

Pour y voir devant nous, le fond de l’oeil est noir. On a un disque noir causé par le nerf optique au fond chaque oeil. Nous ne sommes pas capables de voir ce qu’il y a devant nous sans le cerveau qui reconstruit le milieu de la vision à partir de la périphérie. On peut tromper l’oeil avec les illusions d’optique.

Cette nouvelle compréhension permet de soigner les désordres post-traumatiques avec l’EMDR. Elle réutilise cette phase du sommeil pour rééquilibrer le réseau neuronal. Par exemple, les vétérans de guerre à qui on réapprend que un bruit fort n’est pas forcément associé à un explosif.

Au début des années 2010, des scientifiques ont voulu modéliser ce fonctionnement du cerveau. Le Human Brain Project chercher à faire un programme qui reproduirait le fonctionnement du cerveau sur un ordinateur. Au début ce modèle ne savait pas faire grand chose. Fei-fei Li de l’université de Standford, a constaté qu’un bébé ne sait pas faire grand chose, c’est après exposition à son environnement qu’il apprend. Les chercheurs ont alors exposé le programme à des vidéos, des images, des sons et des textes.

How we teach computers to understand pictures 2015 – Fei Fei Li – Ted: https://youtu.be/40riCqvRoMs?si=FLj3q0q4yjGhMrDG

A chaque contenu est associé une émotion et une force pour imiter l’apprentissage d’un enfant. ex: drôle, très drôle. Le Human Brain Project apprenait aussi bien qu’un enfant humain. Par exemple, il reconnaît un chat.

La société Facebook, vers 2015-2016, a crée deux réseaux neuronaux. Facebook avait accès à beaucoup de contenu pour l’entraînement. Ils ont fait communiquer les deux réseaux. Ces réseaux se parlaient. Facebook a arrêté l’expérience car les deux réseaux avaient crée une nouvelle langue que les humains ne comprenaient pas.

Sam Altman a montré que ces réseaux avaient un vrai talent pour les langues et il a développé son propre réseau neuronal uniquement avec du texte: Chat GPT. Cela s’appelle LLM (large language model). Au même moment, la société de Sam Altma, Open AI a développé un autre réseau neuronal entraîné uniquement avec des images associées à des textes: DALL-E. Cela s’appelle un Clip (contrastive language-image pretraining). DALL-E utilise Chap GPT pour donner du contexte aux images.

En 2022, Chap GPT a fini l’entraînement de DALL-E et de Chap GPT et les a rendus accessibles au public. Ces IA sont des intelligences artificielles génératives: elles sont capables de comprendre une image ou un texte et de s’exprimer sur demande. Par exemple, écrire un poème en 5 vers sur le printemps ou dessiner une marguerite comme Van Gogh. Pour cette utilisation DALL-E et Chap GPT sont extrêmement performants et ils ont rencontré un énorme succès. Des chercheurs ont développé des applications à ces IA: reconnaître une mauvaise herbe dans un champ pour l’arracher mécaniquement, reconnaître une tumeur cancéreuse sur une radio des poumons, être capable de générer des descriptions à des non-voyants, etc. Les LLM (large language model) sont capables d’améliorer un texte.

Mais comme elle parle très bien, les humains ont l’impression qu’elle sait. Certains s’en servent comme un assistant personnel ou comme oracle. Or ces intelligences artificielles travaillent sur la forme, pas sur le fond. Elles n’ont pas de raisonnement, elles ne disent pas la vérité.

Des grandes entreprises comme Microsoft ou Google qui mettent à disposition Chat GPT ou un de ses clônes ont voulu surfer sur l’attente des gens. Ils ont maquillé le LLM pour qu’il ait l’air du raisonnement. Par exemple, montrer les 5 meilleurs restaurants de la ville ou donner des conseils pour le couple.

Le fonctionnement des réseaux neuronaux, l’IA générative, est extrêmement énergivore. Les processeurs qui font fonctionner les réseaux neuronaux ne sont pas faits pour cela. Ces processeurs testent toutes les éventualités jusqu’à trouver la bonne. Dans la phase pilote de l’IA de Google avec un nombre limité d’utilisateurs, la consommation électrique de Google a augmenté de 48%. Générer une image avec DALL-E consomme autant d’électricité que ce qu’il faut pour charger un smartphone. Faire générer une page de texte a Chat GPT émet autant de CO2 que 6 km en voiture. En décembre 2023, il y avait 10 millions d’utilisateurs quotidiens de Chat GPT. Pour dix-vingt textes demandés à Chat GPT, un demi-litre d’eau propre est consommée pour le refroidissement des centres de donnée.

Générer une image consomme autant d’énergie que pour charger un smartphone (et autres chiffres affolants sur les IA) – Usbek & Rica: https://usbeketrica.com/fr/article/generer-une-image-consomme-autant-d-energie-que-pour-charger-un-smartphone-et-autres-chiffres-affolants-sur-les-ia

Pour l’entraînement de ses réseaux neuronaux, chat GPT a utilisé massivement des employés au Kenya sous-payés (2 dollars par jour), maltraités et sans aucune sécurité sociale. Un grand nombre de ces employés sont traumatisés par certaines de ces images choquantes.

‘It’s destroyed me completely’: Kenyan moderators decry toll of training of AI models – The Guardian: https://www.theguardian.com/technology/2023/aug/02/ai-chatbot-training-human-toll-content-moderator-meta-openai

Les industriels font des campagnes de communication massives pour montrer que l’IA peut améliorer la santé, l’agriculture, le changement climatique, la construction. Par exemple, Alphafold de Google a permis de comprendre des millions de protéines là où toute la communauté scientifique arrivait à en comprendre deux par an maximum. Cela sert à créer des médicaments ou à comprendre comment des polluants agissent sur le corps humain. Autre exemple: mettre des robots qui n’arrosent ou mettent des pesticides que là où cela est nécessaire. Dans ces cas-là le bilan de l’IA sera bénéfique pour l’humanité.

Google DeepMind’s Latest AI Model Is Poised to Revolutionize Drug Discovery – Time: https://time.com/6975934/google-deepmind-alphafold-3-ai/

Par contre, si on l’utilise pour des loisirs, pour faire rire ou remplacer des travaux de bureau, on va empirer la crise climatique car cela génèrerait des tonnes de CO2 supplémentaires. Utiliser l’intelligence artificielle pour écouter toute une conversation dans une visioconférence et faire un résumé des discussions a un impact majeur sur l’environnement. Il y a un coût humain et un coût environnemental.

On the Unsustainability of ChatGPT: Impact of Large Language Models on the Sustainable Development Goals – UNU Macau: https://unu.edu/macau/blog-post/unsustainability-chatgpt-impact-large-language-models-sustainable-development-goals

Il faut faire évoluer notre utilisation des IA avec de la recherche publique dans des microprocesseurs pour qu’ils consomment moins. Seule une société à Taiwan, TSMC, produit des microprocesseurs qui répondent à la demande d’Open AI, et ils ne sont pas assez efficients.

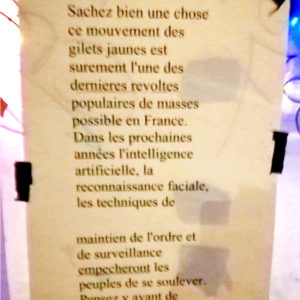

Il faut faire évoluer les législations pour éviter que le training de ces intelligences artificielles se fasse par des quasi-esclaves, et éviter que nos données personnelles ne se retrouvent dans les contenus générés par ces IA.

Remplacer un humain par une IA crée juste du CO2 en plus. L’humain continuera à exister, mais sans travail.

Utilisons l’Intelligence Artificielle mais avec pertinence.

Strategies for mitigating the global energy and carbon impact of artificial intelligence – SDG: https://sdgs.un.org/sites/default/files/2023-05/B29%20-%20Xue%20-%20Strategies%20for%20mitigating%20the%20global%20energy%20and%20carbon%20impact%20of%20AI.pdf